Présentation générale du contenu vidéo de la démonstration.

PiCar

vision system is built with several components

implemented in a real time stamped data flow RTMaps

environment. The whole image processing results is

grouped in a « Bird View »

window [LeC05]

including obstacle detection and road way tracking.

The view is an inversed road plane perspective

reconstructed with a bilinear interpolation of images.

This allows us to represent the vehicle and its

environment in a non projective rectified world. The

computing is done over proprioceptive (gyros,

odometers ...) and exteroceptive (cameras, GPS ...)

sensors. Most of image layer

processing is performed using the OpenCV 2 library [Open02]. The

stereoscopic disparity map that is addressed herein,

is measured via epipolar rectified images [Zha00]. It is

restricted to a Region Of Interest (ROI) that is

limited below the horizon, above a 3 meters blind zone

and within the relevant road way. That restricts the

computation of disparities to a trapezes that delimits

the forward vehicle's trajectory.

The

driving direction is determined with no need of line

marks, thanks to IPM [Ber98] (Inverse Perspective

Mapping) and a Hough transform that votes for road's

border transition. The obstacles are detected

longitudinally and laterally in U and V-disparity dual

projection spaces [Lab04],

knowing the slope of cameras to the ground plane and

the image height of the horizon. A calibration measure

is required to associate the height in the images,

related via an hyperbolic relation to longitudinal

distances in the real world.

References :

[LeC05]

François LE COAT, Yves LAYOUS,

« Localisation

Dynamique

Visuelle

pour

le

positionnement

aérien

d’un

drône » READ Workshop at INT

Évry, France, 1, 2, 3 June 2005.

[Open02] <http://opencvlibrary.sf.net/>

[Zha00]

Zhengyou ZHANG

« A

flexible

new

technique

for

camera

calibration »

IEEE

Transactions

on

Pattern

Analysis

and

Machine

Intelligence,

22(11):1330-1334,

2000.

[Ber98]

Massimo BERTOZZI,

Alberto BROGGI,

Alessandra FASCIOLI,

« Stereo Inverse Perspective Mapping: Theory and Applications »

Image

and

Vision

Computing

Journal,

16(8):585-590,

June

1998.

[Lab04]

Raphaël

Labayrade,

Didier

Aubert,

« Robust

and

fast

stereovision

based

obstacles

detection

for

driving

safety

assistance »

Special

Issue

on

Machine

Vision

Applications

at

the

IEICE

Japanese

journal,

Jan.

2004.

|

|

|

|

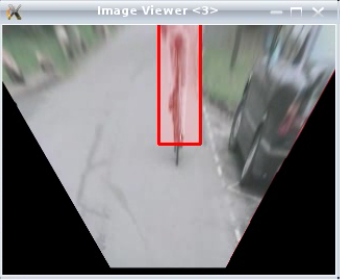

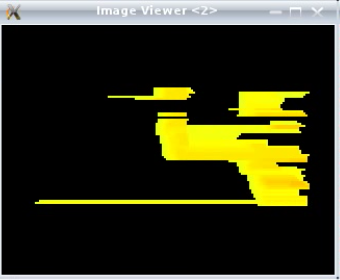

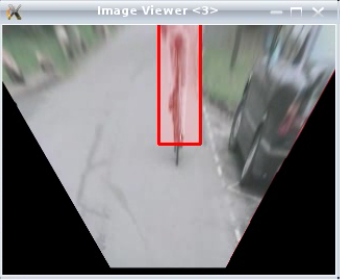

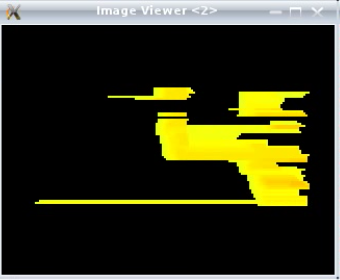

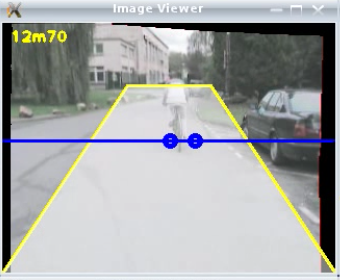

| (1) Image de la caméra gauche en vue "de dessus" (bird view), avec une zone rouge qui délimite l'obstacle. La transformation d'image est une inversion de la projection du plan de la route. | (2) Image de disparité stéréoscopique (Bellman dérécursivé). | (3) Vue "de dessus" synthétique qui correspond à l'inversion de la projection du plan de la route sur le plan image. I.e. la bird-view. Cette vue de la troisième caméra permet la détermination de trajectoire. En sur-impression apparait de flot de mouvement implicite, correspondant à la transformation affine du plan image, approximée entre T-1 et T. | |

|

|

|

|

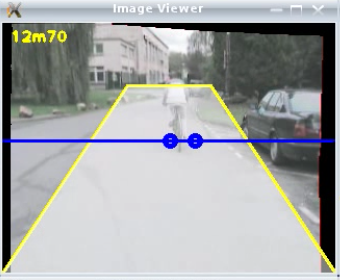

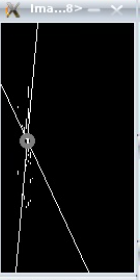

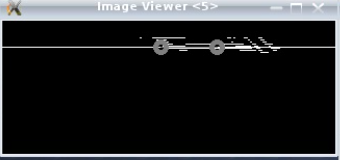

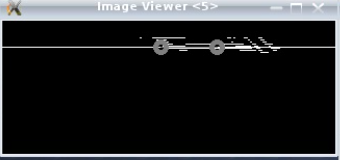

| (4) Image de la caméra gauche rectifiée avec l'horizon à une hauteur 60 dans l'image, ainsi que les limites arbitraires de la voie de circulation (jaunes). La ligne bleue détecte le contact sol/obstacle. Son ordonnée dans l'image est inversement proportionnelle à la distance. L'obstacle potentiel est détecté et sa distance est reportée en mètres. | (5) Image de la caméra droite rectifiée dans laquelle on détecte le bord de route par la méthode IPM. La droite horizontale jaune est à 5 mètres depuis l'avant de PICAR. La hauteur de la droite à 5 mètres est identique dans les images gauche et droite car les images sont rectifiées. La distance en cm correspond à une distance au bord de route droit d'un point 3D arbitraire situé sur la roue avant droite du véhicule. Sa valeur indique le cap du véhicule. | (6) Image de V-disparité seuillée, dans laquelle on a détecté la position de l'obstacle par une ligne verticale. L'équation de la route dans le plan V-disparité est représentée par une ligne oblique qui fait un angle de 65° par rapport à l'horizontale dû à l'inclinaison de la caméra. La transformée de la route coupe "V" à la hauteur de l'horizon. L'intersection des droites, ordonnée de la ligne bleue, est représentée par un cercle gris (obstacle). | (7) Mesure du mouvement apparent du plan de la route estimé par une transformation affine et un filtrage de Kalman. Les paramètres affichés sont donc, les 3 rotation-translations approximées à l'instant T et les 3 rotation-translations estimées à l'instant T-1. Il est aussi affiché un pourcentage correspondant à la qualité de la détermination entre T-1 et T, à l'aide du facteur de corrélation (en %). Lorsque l'indice est en dessous de 30%, l'estimée à T-1 est remise à zéro. |

|

|

|

|

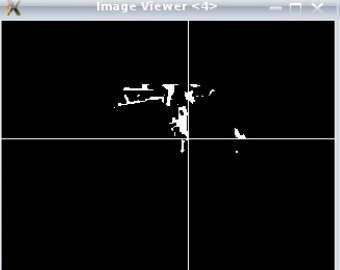

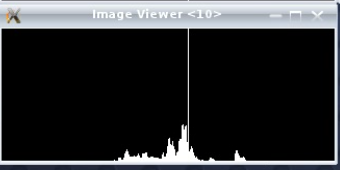

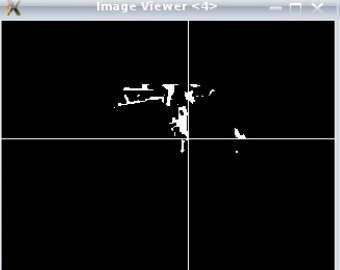

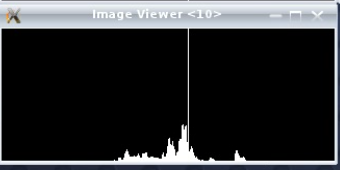

| (8) Image de U-disparité seuillée permettant la détection latérale. | (9) Algorithme de suppression de fond (background substraction) appliqué sur la caméra gauche entre l'image à T-1 et l'image à l'instant T, recalées par rapport au déplacement plan. Le résultat de l'opération de suppression est limité à la voie de circulation. C'est en fait l'image à l'instant T qui est "warpée" par la transformation projective inverse, dont les paramètres sont Tu, Tv et alpha. Ces 3 paramètres sont obtenus en vue de dessus, et correspondent dans la vue de face à Tx (latéral), Tz (longitudinal) et lambda (lacet), respectivement. L'image binaire de résultat permet donc de détecter le mouvement entre T-1 et T, d'obstacles potentiels situés au dessus du plan de la route. | (10) Transformation de Radon (histogramme projeté) selon l'axe V. | (11) Paramètres datés qui remontent des capteurs proprioceptifs. |

|

|||

| (12) Transformation de Radon (histogramme projeté) selon l'axe U. |